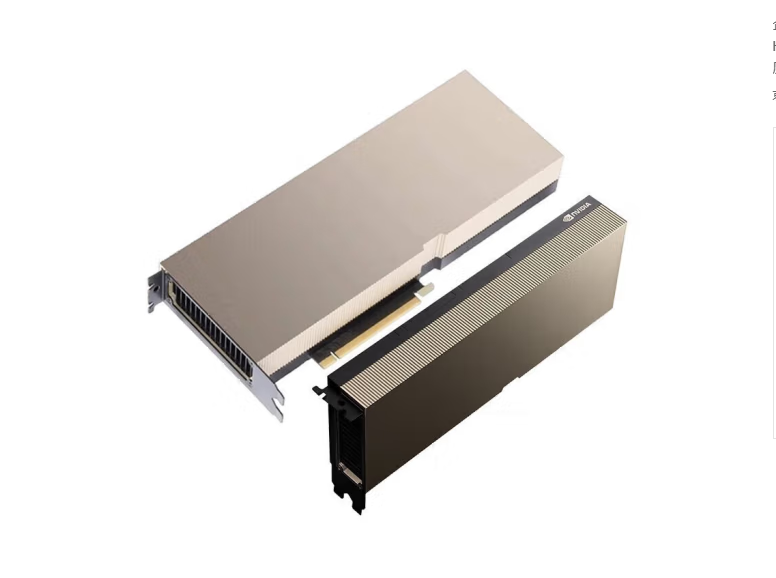

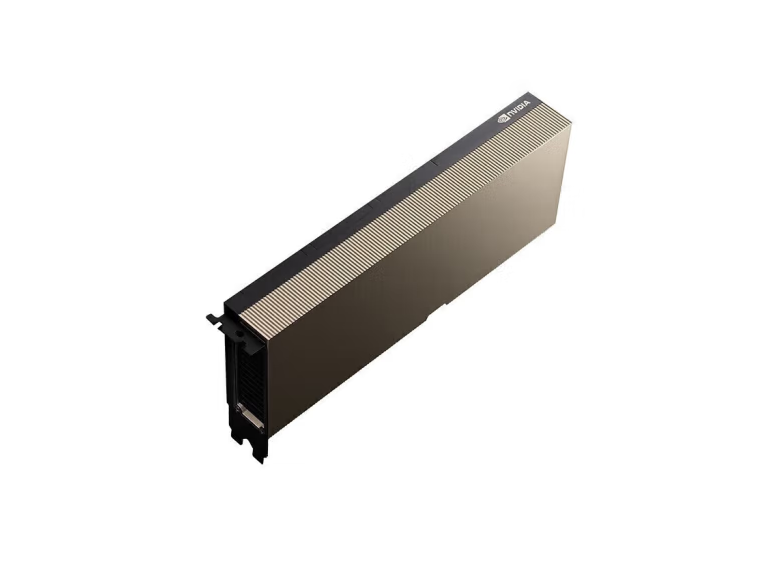

NVIDIA A100显卡是**一款高性能计算平台,专为AI、数据分析和高性能计算(HPC)应用而设计**。以下是对A100显卡相关信息的具体介绍:

1. **性能参数**

- **核心架构**:A100基于NVIDIA的Ampere架构开发,采用7nm工艺制程[^2^][^4^]。该架构提供了强大的并行处理能力,适用于复杂的计算任务。

- **CUDA核心数量**:A100具有6912个CUDA核心,这些核心可以加速各种并行计算任务[^2^]。

- **Tensor核心数量**:A100拥有432个Tensor核心,专门用于深度学习任务,提供高达312 TFLOPS的AI性能[^2^]。

- **显存容量**:A100支持多种显存配置,包括40GB、80GB或640GB的高速HBM2内存,满足不同规模的数据处理需求[^2^]。

2. **技术创新**

- **多实例GPU(MIG)技术**:A100支持MIG技术,可以将单个GPU划分为多个独立的GPU实例,以适应不同的工作负载和用户需求[^1^]。

- **NVLink和NVSwitch技术**:A100支持NVIDIA的NVLink和NVSwitch技术,实现多卡之间的高速互联,进一步提升计算性能和并行计算能力[^2^]。

- **机密计算能力**:A100具备机密计算能力,能够在使用GPU时保护数据的机密性和完整性[^1^]。

3. **市场应用**

- **数据中心**:A100主要面向数据中心应用,为云计算、大数据分析和人工智能提供强大的计算支持[^2^]。

- **云服务提供商**:A100已被多家中国大型云服务提供商采用,包括阿里巴巴、百度和腾讯的云部门[^4^]。

- **市场需求**:由于生成式AI的流行,对基于A100的高性能GPU需求激增,导致其市场价格大幅上涨[^5^]。

总的来说,NVIDIA A100显卡凭借其卓越的性能、技术创新和广泛的应用场景,成为了高性能计算领域的佼佼者。它不仅满足了数据中心和云服务提供商的需求,也推动了人工智能和深度学习技术的发展。

售前咨询专员

售前咨询专员